2022年10月14日下午13:30-17:30,由中国计算机学会CCF主办,CCF YOCSEF上海承办的线上技术论坛“图神经网络的关键技术及应用场景”成功举办。论坛由CCF YOCSEF上海AC委员、复旦大学卢暾教授和CCF YOCSEF上海副主席、上海师范大学张波教授担任执行主席。

微软亚洲研究院(上海)李东胜研究员,哈尔滨工业大学(深圳)徐增林教授、华东师范大学张凯教授、复旦大学邱锡鹏教授、同济大学丁志军教授、王昊奋研究员、赵才荣教授、上海师范大学袁非牛教授等嘉宾出席本次论坛。CCF YOCSEF上海主席、上海理工大学裴颂文教授为论坛致辞,期待本次论坛能够碰撞出思维火花。此外,CCF YOCSEF上海荣誉/优秀AC 李超、温蜜、何高奇,现任AC黄泽良、谢滨欢、李晋国、石亮、马骏、赵登吉、李洋、刘斐也参与了本次论坛。

论坛第一个环节为引导发言,四位嘉宾探讨了“图神经网络”目前的关注焦点与技术趋势。

首先,微软亚洲研究院(上海)的高级研究经理李东胜博士带来题为《Graph Learning for Recommendation》的引导发言。李博士以微软的新闻服务平台入手介绍了推荐系统。他提到,利用图神经网络进行推荐主要依托于三个交互图,即用户和物品的交互图、用户和用户之间的关系图、物品与物品之间的关系图,其中对图的动态建模优化和图的信号处理是解决该类问题的关键。同时,如何将三类交互图进行融合也是十分重要的问题和挑战。

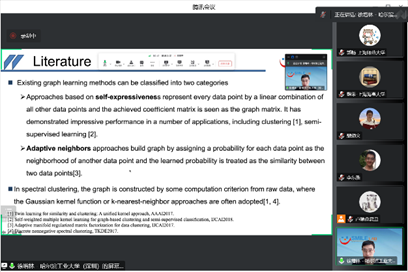

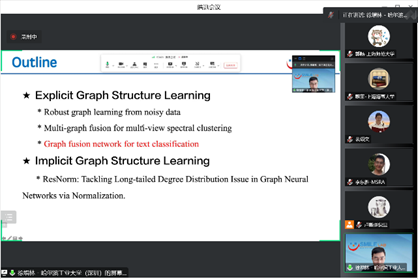

其次,哈尔滨工业大学(深圳)的徐增林教授做了题为《图学习与图神经网络》的引导发言。徐教授表示对图内信息进行表征学习是十分重要的,图神经网络相比之前的方法,在卷积等方面具有优势,如何利用这些关系结构进行构图是该领域的重要挑战。报告以文本分类问题为例,指出可以利用文字在文件中的索引构建图。但这种方法在新文件中匹配度不高,可以考虑文本之间的先验知识进行优化改进,整体流程是从不同角度构建图并且进行图的融合。

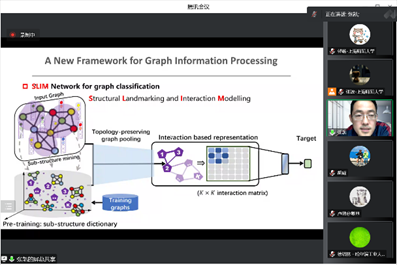

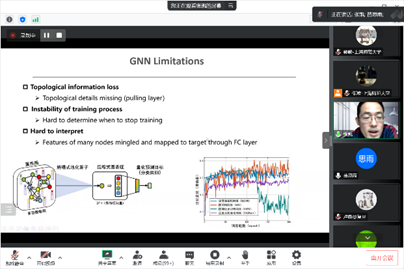

然后,华东师范大学的张凯教授带来题为《复杂系统启发的新型图神经网络》的引导发言。张教授的报告聚焦于图的分类问题。图的卷积和池化操作是现有GNN的常见框架,但会存在拓扑信息损失、训练过程不稳定和难以解释等局限性。为了解决这些问题,张凯教授团队引入了复杂系统的科学思想对图神经网络的设计进行启发,提出了系列解决方案,提升了训练的稳定性和图分类的预测精度。

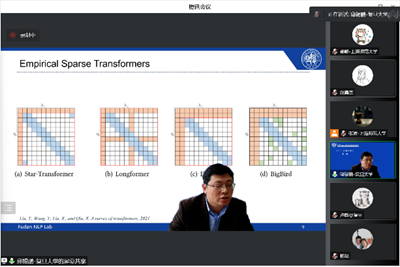

最后,复旦大学的邱锡鹏教授带来题为《社交媒体大数据挖掘技术与应用》的引导发言。针对自然语言处理中transformer中的全连接结构能否进行化简和稀疏的问题,报告中提出了一种新思路。其将原来的全连接transformer模型改成星型transformer,这样既可以大幅度降低模型的复杂度,又可以保持文本之间的联系。在星型transformer的基础上,还可以进行long transformer, sparse transformer等更多层面的优化。

论坛的第二个环节为技术讨论。八位专家学者围绕以下三个问题进行了热烈的讨论。

问题一:图神经网络在表达能力上主要优势体现在哪里?图神经网络是否具有(如何获得)更好的可解释性?

丁志军教授认为图神经网络对图任务学习的可理解性与解释性较好,与传统方法相比具有优势,但在因果性的可解释性方面仍旧存在一些问题亟待解决。

徐增林教授表示将图神经的可信性与可解释性相结合,或成为该问题的突破口。

李东胜博士利用具体案例阐述其优势,如利用transformer和图神经网络结合的方式可以提升表达能力。

王昊奋研究员提到图神经网络的表达能力和优势在于图,但现阶段对于图的一些结构的学习和表达仍然不够。图具有很强的可解释性,但图神经网络的各种表示不具有可解释性,因此,如何发挥图的可解释性,同时规避神经网络存在的各种局限,仍旧有比较长的一段路要走。

问题二:构建GNN最重要的原则是什么?如何提升GNN的泛化能力和扩展性?有没有可能构建GNN的对比基准即GNN的ImageNet?

邱锡鹏教授认为由于构建图的时间维度或空间维度存在差异性,因此在考虑其泛化能力和拓展性时需要考虑这种差异性。

赵才荣教授认为目前GNN主要分为采样和模型解耦两类工作。关于对比基准,可以在已有GitHub上的开源框架基础上加以考虑和改进。

张凯教授认为在构架GNN时如何将文本的时序特性加以考虑并建模是一个很大的挑战,好的模型可以保证其泛化能力和扩展性。

袁非牛教授表示要从任务本身出发去考虑模型的设计问题,以任务为导向可以保证GNN的泛化能力和扩展性。

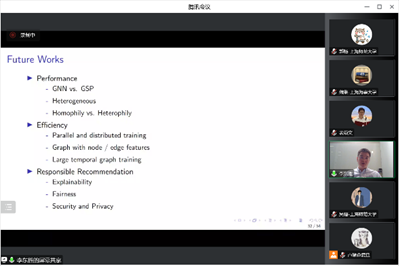

问题三:图神经网络未来还有那些值得期待的研究方向和应用场景?

李东胜博士指出GNN和图处理的异同点和可融合之处、简单图到复杂图的过渡对系统的考验,推荐系统的责任都是未来值得期待的方向。

徐增林教授指出,图泛化是非常值得研究的问题。

张凯教授认为GNN拓扑表征的学习仍然是非常有挑战的问题。

邱锡鹏教授指出需要将GNN与现实生活中的应用场景相结合,从而惠及更多的人,落地方面的探索是非常重要的问题。

丁志军教授指出目前网络金融风控也应用到了图神经网络的理论基础和框架,而如何确定训练的框架和数据量的大小仍亟待讨论。图随着时间进行动态变化在金融场景中也需要重点关注。

王昊奋研究员指出GNN的预训练模型尤其是大模型仍旧较少。同时,大图的训练是需要提升的方面。应用场景方面,智慧城市、智慧交通等方面也开始加大对GNN的探索与应用。

赵才荣教授认为GNN的泛化能力和可扩展性、以及构建GNN的大模型是学术届内达成共识的发展方向。另外,对其性能的提升仍旧是需要不断探索的方向。在芯片领域上应用GNN也取得了不错的效果,值得关注。

袁非牛教授指出可以利用GNN进行模糊搜索以减少训练的冗长过程。在人工智能教育、视觉分析等领域的学情分析、图像分析等也可考虑利用GNN进行更加高级的逻辑推理和预测。

最后,YOCSEF上海主席、上海理工大学裴颂文教授对论坛进行了总结。

论坛历经四小时,气氛十分热烈,直播吸引了来自全国10余个省份的近500人次。各位学者的精彩分享及热烈的技术讨论引发了各位参与者的思考,也为大家提供了更多的新想法与新思路。